« Les plateformes numériques ne sont pas des outils neutres ; ce sont de véritables puissances qui lancent un défi à notre souveraineté politique et cognitive » signale Thomas HUCHON

« Les plateformes numériques ne sont pas des outils neutres ; ce sont de véritables puissances qui lancent un défi à notre souveraineté politique et cognitive » signale Thomas HUCHON

Entretien intégrée à la partie « Crise politique » de l'étude « Comprendre la polycrise »

Journaliste et spécialiste de la désinformation, Thomas Huchon alerte sur l’emprise croissante des plateformes numériques sur nos espaces démocratiques. Ce ne sont plus des outils, mais des puissances sans contre-pouvoir, capables de façonner nos comportements, nos opinions et nos décisions collectives à une échelle inédite. Leur modèle économique fondé sur la captation de l’attention alimente une économie de l’indignation, déstabilise le débat public et fragilise les institutions, piégées dans une double contrainte : réagir les disqualifie, se taire les affaiblit. Cette crise cognitive, informationnelle et politique n’est pas périphérique mais systémique et instrumentalisée par des puissances privées déterminées à fracturer nos sociétés. À l’heure où la France et l’Europe défendent leur souveraineté face aux ingérences, elles ne pourront se refonder sans traiter les réseaux sociaux comme des acteurs politiques à réguler, ou à écarter.

Pensez-vous qu’Internet joue encore aujourd’hui le rôle d’outil d’émancipation qu’on lui prêtait à ses débuts ?

Pas du tout. On a présenté Internet comme un espace de savoir libre, accessible à tous et une promesse de démocratisation. Mais ce qu’on a construit en réalité, c’est une architecture dominée par les lois du marché. Très vite, notre attention est devenue une ressource à exploiter. Nous n’avons pas vu venir cette bascule, ou en tout cas, nous avons mis du temps à la comprendre.

Dans les faits, cette liberté d’informer et de s’informer s’est accompagnée d’un dispositif de surveillance global, invisible et permanent. Ce n’est pas une figure de style : les plateformes que nous utilisons sont conçues pour observer, enregistrer et modéliser nos comportements. Elles ne sont pas là pour partager des idées, elles sont là pour capter notre temps de cerveau disponible. Ce qu’on nous a présenté comme une libération s’est en réalité révélé être un dispositif de contrôle extrêmement raffiné, le tout pour vendre des publicités.

Il y a quelque chose de profondément paradoxal dans cette promesse d’émancipation qui se transforme en mécanisme de domination. On nous disait que l’État était Big Brother, et que Facebook allait nous libérer. Or, en réalité, c’est exactement l’inverse. Les réseaux sociaux sont maintenant capables de prédire nos réactions, d’anticiper nos engagements et de nous orienter. Et ce qui les rend encore plus dangereux, c’est leur capacité à rester dissimulé derrière l’idée de liberté.

Quel rôle ont joué, et jouent encore, les grandes plateformes numériques dans la déformation du paysage informationnel ?

Les plateformes ont imposé une logique où ce qui compte, ce n’est plus la véracité, mais la viralité. Leur modèle économique repose sur le fait de nous garder connectés le plus longtemps possible. Or, ce qui fonctionne le mieux pour cela, ce sont les contenus extrêmes, émotionnels, clivants. C’est une économie de la colère et de l’indignation.

Et les plateformes n’assument pas leur rôle. Elles prétendent être des « tuyaux » neutres, alors qu’elles agissent comme de véritables médias. Elles orientent ce que nous voyons, ce que nous pensons et ce qui nous paraît important. Elles hiérarchisent l’attention collective. Et comme elles ne répondent pas aux règles du débat démocratique, ni aux obligations d’un média classique, elles échappent à toute forme de contrôle réel.

Cela crée une situation où l’espace public est parasité en permanence par des signaux qui ne sont pas orientés vers la compréhension, mais vers l’amplification. Cette mécanique produit un effet très clair : elle déstructure notre rapport au réel. Il n’y a plus de repères communs, plus de temporalité partagée. Chacun est enfermé dans une bulle algorithmique qui lui donne l’illusion d’un monde cohérent, mais qui n’est qu’un reflet de ses biais.

Est-ce que certaines stratégies de manipulation vous paraissent particulièrement représentatives de ces nouveaux conflits informationnels ?

Deux modèles très puissants me paraissent aujourd’hui emblématiques : la stratégie chinoise et la stratégie russe. Côté chinois, on a TikTok. C’est un outil de captation massive des comportements, capable d’observer les tendances, de comprendre les codes culturels dominants et d’y répondre en temps réel. Mais ce n’est pas seulement un instrument d’influence, c’est aussi un rouage d’un système industriel plus large, qui relie contenus, production et consommation. C’est un outil de domination économique autant que culturelle.

Côté russe, la méthode est plus agressive. Jusqu’en 2018, on observait une stratégie fondée sur la fabrication de faux récits, inspirée des pratiques du KGB. Cela impliquait une vraie connaissance des sociétés ciblées. C’est ce qu’on a pu observer aux États-Unis en 2016. Un exemple type d’opération a été la création, pour une même ville, de deux comptes Facebook par des agents russes : l’une pro-police, l’une pro-Black Lives Matter. En alimentant ces pages Facebook, suivies par les locaux, les agents russes sont arrivés à orchestrer des manifestations et même des affrontements entre ces deux groupes. Ce type d’opération, très abouti, nécessitait de produire du contenu, de simuler des communautés, de comprendre les codes locaux. C’était efficace, mais complexe.

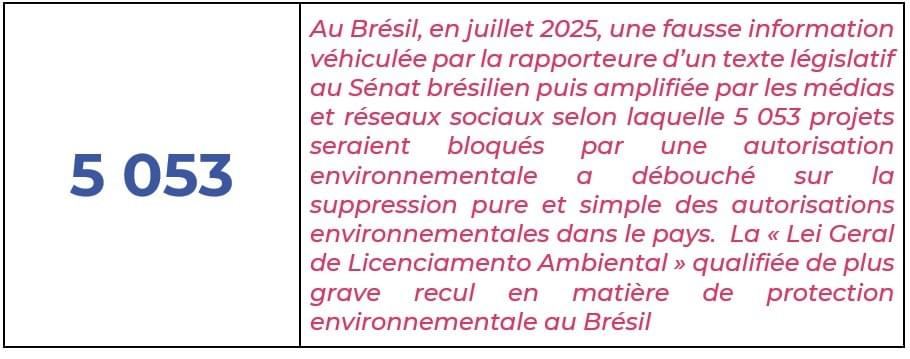

Aujourd’hui, la stratégie russe a évolué : il ne s’agit plus de créer, mais de manipuler les algorithmes. Le cas des punaises de lit en France est un exemple édifiant. Il n’y avait aucun fait nouveau, aucune hausse de signalements. Mais en injectant soudain des milliers de tweets sur le sujet, des comptes liés à la Russie ont réussi à imposer cette rumeur comme une actualité prioritaire. Les rédactions ont suivi. L’alerte est devenue une affaire nationale. Et derrière, c’est tout un pan de l’économie française qui a été touché, et cela à peine six mois avant les Jeux Olympiques. C’est une manière extrêmement efficace de détourner l’attention publique des sujets de fonds, mais aussi de ternir l’image d’un pays.

Et ce genre de manipulation ne concerne pas que les élections ou les tensions géopolitiques. L’un des cas les plus flagrants, c’est celui de la désinformation climatique. Depuis les années 1970, certaines grandes industries des secteurs pétrolier et de l'automobile ont sciemment financé des think tanks comme le Heartland Institute ou la Heritage Foundation pour produire de fausses études, remettre en cause le consensus scientifique sur le réchauffement climatique. Aujourd’hui encore, une grande partie des arguments climato-sceptiques que l’on trouve sur Internet vient directement de ce travail de désinformation.

Quel rôle jouent les techniques de personnalisation de contenu dans les dynamiques d’influence que vous observez ?

C’est un point crucial. Les plateformes ne se contentent pas de diffuser de l’information : elles adaptent ce que vous voyez en fonction de ce qu’elles savent de vous. Plus elles ont de données, plus elles sont efficaces pour modeler votre réception. Ce n’est pas une théorie : des études récentes montrent que lorsqu’une intelligence artificielle dispose de suffisamment d’informations sur un individu, elle peut le convaincre de changer d’avis sur un sujet dans 80 % des cas. C’est vertigineux, c’est du jamais vu.

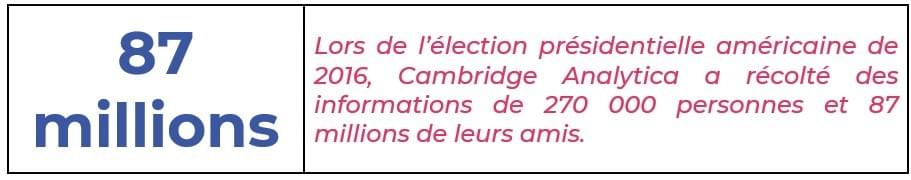

Et ce n’est pas une hypothèse théorique. C’est ce qui s’est passé pendant la campagne de Trump en 2016. Cambridge Analytica a permis d’identifier certains électeurs démocrates qui, tout en vivant dans des zones progressistes, avaient des préjugés racistes qu’ils n’osaient pas exprimer. Ces personnes ont reçu des contenus faits sur mesure par du ciblage politique : des messages qui visaient les minorités, les migrants, la criminalité, avec un ton et un vocabulaire adaptés à leur profil. Et ça a fonctionné. C’est ça, aujourd’hui, la puissance de ces outils.

Quand ces contenus deviennent violents ou diffamatoires, que se passe-t-il concrètement ?

C’est là que les limites du système apparaissent dans toute leur brutalité. Aujourd’hui, on peut recevoir des centaines de messages de harcèlement ou de menaces sur une plateforme, sans qu’aucune sanction concrète ne suive. En théorie, la loi existe. En revanche, dans la pratique, elle est inapplicable à cette échelle. Il faut faire constater chaque message par un huissier, un par un. Un seul tweet constaté : 250 euros. Si vous en recevez 200, faites le calcul. C’est hors de portée.

Le résultat, c’est qu’on a ouvert un espace où tout est permis, sans protection réelle pour les victimes. Ceux qui agressent savent qu’ils ne risquent rien. Ceux qui subissent sont contraints au silence ou à la résignation. C’est une impunité qui ne dit pas son nom, mais qui structure l’ensemble du fonctionnement des plateformes.

Ces attaques informationnelles affectent-elles aussi la manière dont les institutions publiques peuvent agir ?

Absolument. C’est peut-être l’un des effets les plus pervers de ces logiques : elles neutralisent la réponse publique. Quand une rumeur éclate, les institutions peuvent toujours démentir, faire un communiqué, mobiliser des experts… mais c’est trop tard. Le rythme des réseaux sociaux ne leur laisse pas le temps.

Pire encore : dès que l’État cherche à corriger ou à modérer un contenu, il devient suspect. On l’accuse de vouloir contrôler l’opinion ou de dissimuler des choses. Il se retrouve pris dans une forme de double contrainte : s’il ne dit rien, il laisse faire mais s’il réagit, il est soupçonné. C’est un piège parfait. Et ça a pour effet de paralyser les institutions, de les décrédibiliser même. À la fin, ce n’est pas seulement l’information qui est fragilisée, c’est la légitimité même de ceux qui sont censés la garantir. Et c’est très inquiétant.

Est-il encore possible de reprendre le contrôle sur les dynamiques d’influence numérique, et dans quelles conditions cela vous semble-t-il possible ?

Si on veut sérieusement reprendre le contrôle, il ne s’agit pas d’ajuster quelques curseurs ou de corriger les excès les plus flagrants. Il faut comprendre que les réseaux sociaux ne sont pas des outils neutres. Ce sont des puissances d’influence à part entière, qui modifient en profondeur la manière dont les individus s’informent, pensent et interagissent. Ils façonnent l’espace public sans aucune des obligations qui s’imposent aux acteurs traditionnels de l’information.

À partir de là, deux options s’offrent à nous. Soit on les régule vraiment, c’est-à-dire qu’on les traite comme des médias, avec des obligations de transparence, de modération, de responsabilité juridique. Soit on les ferme. Je sais que cette proposition choque. Mais si une entreprise refuse d’appliquer les lois de la République, si elle se positionne au-dessus des normes collectives, alors il n’y a aucune raison de continuer à lui donner accès à notre espace démocratique.

Et ce n’est pas comme si on n’avait aucun précédent. Le droit français encadre depuis longtemps la parole publique. La loi du 29 juillet 1881 sur la liberté de la presse permet de sanctionner des propos diffamatoires, mensongers ou calomnieux, non pas parce qu’ils sont faux, mais parce qu’ils causent un préjudice concret. L’idée, ce n’est pas de punir l’erreur, mais de protéger les personnes contre ses effets destructeurs. Et cette régulation a fonctionné, pendant un siècle et demi, que ce soit dans la presse ou à la télévision, notamment avec le CSA (aujourd’hui ARCOM), qui veille à l’équilibre de la parole audiovisuelle.

Les réseaux sociaux ont complètement contourné cette architecture. Ils atteignent des millions de personnes, diffusent des contenus viraux, émotionnels, parfois dangereux, et personne n’est responsable. Pas de représentant légal poursuivable, pas de cadre déontologique, pas d’engagement sur les effets produits.

Pour que ce soit bien clair : je ne dis pas ça à propos de toutes les technologies. J’ai souvent dit que je ne souhaitais pas qu’on interdise l’intelligence artificielle (IA). Pourquoi ? Parce que l’IA, elle, peut être utilisée dans des cadres très précis : par exemple, pour améliorer la médecine, détecter un cancer avec plus de précision que des experts humains. Il y a une forme de rationalité collective derrière ça. Les réseaux sociaux, eux, n’ont pas de finalité constructive. Ce sont des machines de captation de l’attention, conçues pour maximiser le temps passé à l’écran et donc la vente de publicité. Rien d’autre. Et à partir de là, on peut se poser une question simple : est-ce qu’une société démocratique peut continuer à tolérer l’existence d’un outil dont l’unique fonction est de rendre les citoyens manipulables ?

Ma réponse est non. Soit on leur impose des règles, sérieuses, effectives. Soit on les ferme. C’est aussi simple que ça.

Beaucoup objectent qu’une fermeture des réseaux risquerait de porter atteinte à la liberté d’expression. Que répondez-vous à cela ?

Je pense qu’on se trompe de débat. La liberté d’expression est une valeur fondamentale, bien sûr, mais elle ne suffit pas à garantir une démocratie. Ce qui fait réellement tenir un régime démocratique, c’est le libre arbitre. C’est la capacité qu’ont les citoyens à se forger une opinion autonome et de faire des choix éclairés. Aujourd’hui, c’est cette liberté-là qui est mise en danger.

Quand vous êtes exposés à des contenus qui n’ont pas été choisis pour leur valeur ou leur pertinence, mais parce qu’ils ont le potentiel de vous faire cliquer, vous n’êtes plus vraiment libre. Vous êtes influencés sans le savoir, vous continuez à croire que vos opinions vous appartiennent, alors qu’elles ont été façonnées par des algorithmes.

Tout cela a des effets très concrets, notamment sur les plus jeunes. On le sait : les propres études internes de Facebook ont montré que plus de 15 % des adolescentes britanniques déclarent avoir des pensées suicidaires après avoir consulté Instagram. Cette information a été remontée aux dirigeants, et pourtant, rien n’a changé. Pas un réglage d’algorithme, pas une pause dans le modèle. Ils savaient que leur produit détruisait la santé mentale d’une partie de la jeunesse, et ils ont continué.

En parallèle, ces plateformes laissent proliférer des contenus d’une extrême violence. Elles servent aujourd’hui de caisse de résonance à des mouvances radicales : masculinistes, suprémacistes, techno-fascistes. Ce sont des groupes bien réels, organisés, qui propagent la haine. Et ils le font dans un environnement qui leur offre une visibilité maximale et une impunité totale.

Face à cela, il ne suffit plus d’appeler à la modération. Il faut regarder en face la nature de ce qui circule, et accepter que certaines limites doivent être posées. On ne peut pas laisser circuler des contenus qui incitent à la haine, qui humilient, qui détruisent, au nom de la liberté d’expression. C’est une question de sécurité publique. Quand vous avez des adolescentes qui développent des pensées suicidaires après avoir passé des heures sur les réseaux, quand vous avez des enseignants menacés ou tués, des journalistes harcelés en ligne, il ne s’agit plus d’opinion. Il s’agit de violences concrètes, de dégâts réels.

Pourquoi, selon vous, les décideurs peinent-ils autant à prendre la mesure du danger ?

Parce qu’ils ne comprennent pas à qui ils ont affaire. On continue à parler de ces plateformes comme de simples entreprises technologiques ou partenaires économiques. Mais ce ne sont pas des partenaires, ce sont des puissances. Et des puissances qui ne respectent aucune des règles qui fondent nos systèmes démocratiques.

Quand un chef d’État s’assoit face à Mark Zuckerberg, il le fait en sachant très bien que l’autre en sait probablement plus sur lui que son propre entourage. Il connaît ses habitudes, ses failles, ses goûts, ses recherches, ses communications… Et ce déséquilibre-là pèse dans la discussion. Parce que la personne en face détient un pouvoir informationnel colossal, un pouvoir qui n’a jamais existé à cette échelle auparavant.

Ce pouvoir repose aussi sur des concentrations capitalistiques inédites. Mark Zuckerberg détient plus de 60 % des droits de vote chez Meta. Elon Musk contrôle seul la plateforme X. Jeff Bezos, avant son divorce, possédait l’intégralité du capital d’Amazon. Même Bernard Arnault, pourtant à la tête du plus grand groupe de luxe au monde, ne possède qu’environ un tiers de LVMH. Autrement dit, ces dirigeants exercent un pouvoir sans contrepoids réel. Ils ne sont soumis ni à de véritables conseils d’administration indépendants, ni à des mécanismes de régulation démocratique. Ce sont des acteurs à part, dotés d’une autonomie quasi totale dans leur gouvernance.

Les États, eux, sont coincés dans des logiques institutionnelles lentes. Ils raisonnent en droit, en juridiction, en souveraineté nationale. Pendant ce temps, les plateformes avancent à la vitesse de la lumière, franchissent les frontières, échappent aux régulations. Elles font du lobbying à Bruxelles, à Paris, à Washington. Elles recrutent les meilleurs juristes, les meilleurs communicants. Elles parlent un langage que nos responsables politiques ne maîtrisent pas.

Au fond, ce qui est en jeu, c’est le pouvoir de l’information. Ces boîtes ne vendent pas des téléphones ou des voitures. Elles façonnent ce qu’on voit, ce qu’on pense, ce qu’on croit. Elles structurent l’espace public à leur image, sans avoir jamais été élues pour ça. Tant que l’on continue à leur parler comme à des partenaires commerciaux, on passe complètement à côté du problème.

Au-delà des institutions, est-ce qu’il existe des acteurs qui vous semblent jouer un rôle décisif dans cette lutte ?

Oui, heureusement. Il y a des ONG, des associations d’éducation aux médias, des enseignants, des journalistes, des éducateurs qui font un travail remarquable. Je pense à Samuel Paty, à Dominique Bernard. Je pense à tous ceux qui interviennent dans les classes, qui forment les jeunes à l’esprit critique, qui tentent de remettre un peu de nuance dans un débat public saturé de violence et de simplisme. Ils sont en première ligne.

Ce qu’ils font n’est pas toujours visible, ni valorisé. Ils se battent souvent dans l’ombre, avec peu de moyens, parfois dans l’indifférence, parfois même contre leur propre hiérarchie. Mais leur rôle est décisif. Sans eux, on aurait probablement déjà basculé dans une forme de dystopie sociale et cognitive. Il faut les soutenir, les écouter, et leur donner les outils pour continuer ce travail essentiel.

Est-ce qu’un renversement est encore possible ?

J’y crois, oui. Peut-être naïvement, mais j’y crois. On a mis fin au nazisme, au fascisme, au communisme. On mettra aussi fin à cette forme de techno-fascisme. Mais ce sera long. Ce sera difficile.

Surtout, il ne faut pas se tromper de combat : ce n’est pas une affaire de régulation cosmétique, ou de chartes éthiques. C’est un affrontement politique de fond. Un enjeu de souveraineté. Et il faut que les responsables publics prennent enfin la mesure de ce qui est en jeu.

Moi, je continue d’alerter, de témoigner, de former. Je vois bien que certains ne veulent plus m’écouter. Mais c’est trop important pour lâcher.

L’Institut Open Diplomacy, fondé en 2010 par Thomas Friang, est un think tank reconnu pour ses travaux d’intérêt général. En 2025, face à l’accumulation de crises géopolitiques, écologiques, économiques et politiques qui s’aggravent mutuellement, il s’est donné pour mission de « comprendre et combattre la polycrise ».

Pour mener à bien cette mission, l’Institut a constitué un groupe de prospective. Les 10 co-auteurs du rapport ont engagé la réflexion en consultant plus de 30 experts de haut niveau afin d’analyser ces quatre grandes systémiques et leurs rétroactions, pour comprendre la bascule historique qu’opère la polycrise.

Cette étude, intégralement accessible via ces pages, est présentée au Sénat le 31 octobre 2025. Elle marque ainsi le 15e anniversaire de l’Institut Open Diplomacy et pose les bases du prochain sommet du Y7. Organisé sous présidence française du G7, il aura pour thème « combattre la polycrise ».